23 يناير 2025

مقالات

المملكة الرقمية والذكاء الاصطناعي: أمان وابتكار في عالم متصل

#الأمن السيبراني في عصر الابتكار #بالذكاء ـ الاصطناعي

تزايدت شعبية تطبيقات #الذكاء_الاصطناعي مثل #ChatGPT و#Google_Geminiو#GitHub_Copilot بشكل سريع بسبب إمكانياتها الهائلة في الابتكار وزيادة الإنتاجية وحل المشكلات. ولكن مع تزايد اندماج هذه التقنيات في المهام اليومية، يجب على المواطنين في #المملكة_العربية_السعودية أن يكونوا على دراية بمخاطر #الأمن_السيبراني المرتبطة باستخدامها.

سنستعرض ضمن هذا المقال هذه المخاطر وتقديم نصائح مفيدة، أمثلة واقعية واستراتيجيات عملية للتعامل مع #العالم_الرقمي بطريقة آمنة وأخلاقية.

وقد أصدرت الهيئة الوطنية للأمن السيبراني (NCA) في #المملكة_العربية_السعودية إرشادات شاملة لتعزيز الوعي بالأمن السيبراني عند استخدام المنصات الرقمية. وتهدف هذه الإرشادات إلى حماية البيانات الحساسة ومنع إساءة استخدام التقنيات الناشئة، كما تدعم الهيئة السعودية للبيانات والذكاء الاصطناعي (SDAIA) مبادرات مثل أطر أخلاقيات #الذكاء_الاصطناعي وبرامج حماية البيانات لتنظيم استخدام #الذكاء_الاصطناعي بشكل مسؤول، مما يضمن بيئة رقمية أكثر أمانًا.

لماذا تعتبر التوعية بالأمن السيبراني مهمة؟

تُعرّض تقنيات الذكاء الاصطناعي المستخدمين لعدد من المخاطر لأنها تعتمد في الغالب على المعالجة عبر الإنترنت والبنية التحتية السحابية. والخطوة الأولى لتقليل هذه المخاطر هي الوعي بها:

يتعرض المستخدمون جرّاء تقنيات #الذكاء_الاصطناعي لعدد من المخاطر، حيث تعتمد بشكل رئيسي على المعالجة عبر الإنترنت والبنية التحتية السحابية. وبالتالي فإن الوعي بهذه المخاطر هو الخطوة الأولى لتفاديها ومنها

مشكلات #خصوصية_البيانات: التي تتعلق بالوصول غير المصرح به إلى المعلومات الخاصة أو الحساسة التي يتم إدخالها في أنظمة الذكاء الاصطناعي، ما يتطلب الالتزام الصارم بنظام حماية البيانات الشخصية في المملكة العربية السعودية(2024 (#PDPL) (OpenAI.

#الهجمات_الاحتيالية والهندسة الاجتماعية: إذ تعد رسائل البريد الإلكتروني الإحتيالية ذات الطابع المقنع، من المخاوف المقلقة، خاصة في ظل النمو السريع للاقتصاد الرقمي في #المملكة_العربية_السعودية .(NCSC, 2023)

#ثغرات_الكود البرمجي: حيث أن المطورون قد يخطئون ويضعون ثغرات أمنية في برامجهم أثناء استخدام أدوات مثل GitHub_Copilot. (GitHub, 2023)#

التضليل وإساءة الاستخدام: قد تكون مخرجات أدوات #الذكاء_الاصطناعي متحيزة أو غير دقيقة من الناحية الواقعية، مما قد يؤدي إلى أخطاء جسيمة في الأوساط الأكاديمية أو المهنية .(Chan, 2023)

ولمواجهة هذه التحديات محليًا، عملت الهيئة الوطنية للأمن السيبراني (NCA) والهيئة السعودية للبيانات والذكاء الاصطناعي (SDAIA) على توحيد الجهود مع القطاعين العام والخاص لتثقيف المستخدمين وتعزيز البنى التحتية للأمن السيبراني، مما يساهم في تقليص الفجوة بين المخاطر المحتملة واستراتيجيات الحد منها.

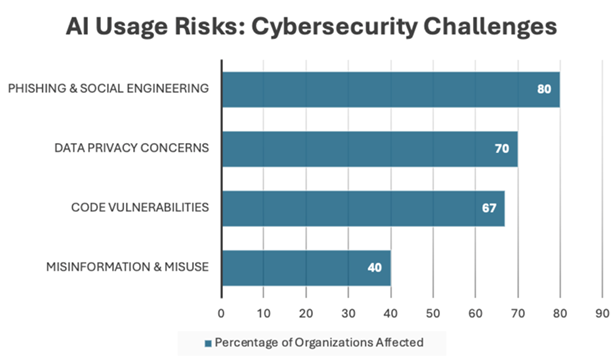

(الشكل 1): مخاطر استخدام #الذكاء_الاصطناعي: تحديات #الأمن_السيبراني

يعرض الرسم البياني التالي أهمية المخاطر الشائعة المرتبطة باستخدام #الذكاء_الاصطناعي في الشركات. ووفقًا لمصادر مثل Security Middle East وArab News وAGBI، فإن مشكلات #خصوصية_البيانات ورسائل #التصيد_الاحتيالي المدعومة بالذكاء الاصطناعي، تمثل أعلى التهديدات نظرًا للتحول الرقمي السريع في اقتصاد المملكة، كما تُعد ثغرات الكود المرتبطة بالذكاء الاصطناعي والمعلومات المضللة مصدر قلق كبير لكل من المطورين والمستخدمين النهائيين.

الدروس المستفادة من الحالات الواقعية

تعريض البيانات الشخصية للخطر

ضمّن رائد أعمال معلومات مالية خاصة في اقتراح عمل، مستخدماً تقنيات الذكاء الإصطناعي، ما أدّى إلى تخزين هذه المعلومات على خوادم منصة #الذكاء_الاصطناعي. ويبرز هذا الحدث الأهمية الكبيرة لفهم سياسات البيانات التي تتبعها شركات #الذكاء_الاصطناعي (OpenAI, 2024)

إنشاء رسائل #تصيد_احتيالي

تعرضت إحدى شركات البنوك لرسائل تصيد احتيالي متطورة، أُرسلت من قبل مجرمين إلكترونيين باستخدام إمكانيات الذكاء الاصطناعي. وانخدع الموظفون وقاموا بالكشف عن كلمات المرور الخاصة بهم، مما يسلط الضوء على الحاجة الماسة لتدريب الموظفين بشكل شامل على التعرف على أساليب #التصيد_الاحتيالي (NCSC,2023)

أجزاء غير مؤمنة من التعليمات البرمجية

أثناء استخدام أداة #GitHub_Copilot لتسريع عملية التطوير، قام أحد المطورين عن غير قصد بإضافة تبعية خطيرة، ما عرّض النظام لاختراق أمني، الأمر الذي يشدد على أهمية إجراء مراجعات دقيقة واختبارات شاملة للتعليمات البرمجية .(GitHub, 2023)

عدم احترام القواعد الأكاديمية

تعرض طالب لعقوبات أكاديمية بعد استخدامه لدراسة تم إنشاؤها بواسطة #الذكاء_الاصطناعي تحتوي على مصادر وهمية. يوضح هذا المثال أهمية التحقق من صحة المعلومات التي يتم إنشاؤها باستخدام تقنيات #الذكاء_الاصطناعي .(Chan, 2023)

كيفية الحفاظ على الأمان أثناء استخدام أدوات #الذكاء_الاصطناعي

لتقليل المخاطر، يجب على المقيمين في #المملكة_العربية_السعودية تنفيذ الاستراتيجيات التالية:

فحص سياسات الخصوصية: من خلال التعرف على كيفية قيام منصات #الذكاء_الاصطناعي بجمع بياناتك وتخزينها واستخدامها. وتأكد من الامتثال للائحة حماية البيانات الشخصية السعودية .(OpenAI, 2024) (#PDPL)

تجنب مشاركة المعلومات الخاصة: عبر الامتناع عن إدخال البيانات الحساسة مثل الملكية الفكرية أو البيانات المالية أو المعلومات الشخصية في تقنيات #الذكاء_الاصطناعي. والذي يعد من الأمور الضرورية للشركات لحماية ممتلكاتها الفكرية.

التحقق من نتائج #الذكاء_الاصطناعي: بالتحقق من دقة المحتوى الذي يتم إنتاجه بواسطة #الذكاء_الاصطناعي من خلال مقارنته بمصادر موثوقة. والذي يجب اتباعه بشكل خاص في الأعمال المهنية والأكاديمية .(Chan, 2023)

تعزيز إجراءات الأمان: عن طريق إنشاء كلمات مرور قوية وفريدة لجميع الحسابات المرتبطة بأدوات #الذكاء_الاصطناعي وتفعيل خاصية التحقق الثنائي .(2FA)

المشاركة في التوعية بالأمن السيبراني: بهدف البقاء على اطلاع بالمخاطر الجديدة، شارك في الأنشطة التي ينظمها الاتحاد السعودي للأمن السيبراني والبرمجة والدرونز .(#SAFCSP)

فحص الشيفرات البرمجية التي يتم إنشاؤها بواسطة #الذكاء_الاصطناعي: إذ أنه يجب على المطورين فحص الشيفرات البرمجية المطورة بواسطة #الذكاء_الاصطناعي واختبارها بدقة لاكتشاف ومعالجة أي ثغرات .(GitHub, 2023)

أهم النقاط المستفادة من دراسات الحالة

النقطة الأولى: لتجنب التعرض غير المقصود للبيانات، يجب دائمًا الانتباه لسياسات البيانات الخاصة بمنتجات #الذكاء_الاصطناعي.

النقطة الثانية: تدريب الموظفين على التعرف على محاولات #التصيد_الإلكتروني وتجنبها، خصوصًا في البيئات المهنية.

النقطة الثالثة: للحد من المخاطر الناتجة عن منصات البرمجة المدعومة بالذكاء الاصطناعي، قم بمراجعة الشيفرات البرمجية بانتظام.

النقطة الرابعة: للحفاظ على النزاهة الأكاديمية والمهنية، تحقق من صحة جميع المخرجات التي يتم توليدها بواسطة #الذكاء_الاصطناعي.

ويجب أن يُحفَّز المواطنون السعوديون على استكشاف برامج أخلاقيات #الذكاء_الاصطناعي التي تقدمها الهيئة السعودية للبيانات والذكاء الاصطناعي (SDAIA)، والمشاركة في ورش العمل المتعلقة بالأمن السيبراني التي تنظمها الاتحاد السعودي للأمن السيبراني والبرمجة والدرونز (SAFCSP)، للبقاء في حالة تأهب ومواجهة التهديدات الناشئة.

ختاماً، كن آمنًا سيبرانيًا اليوم

#يغيّر الذكاء_الاصطناعي من خلال حلول مثل #ChatGPT و#Google_Gemini و#GitHub_Copilot، الطريقة التي نستخدم بها #التكنولوجيا، ويفتح آفاقًا جديدة للإبداع والإنتاجية. وللحد من المخاطر المرتبطة بهذه الأدوات، يجب استخدامها بمسؤولية من خلال الالتزام بأفضل الممارسات والمشاركة في المبادرات الإقليمية للأمن_السيبراني، إضافة إلى مواكبة التهديدات الجديدة، لرفع مستوى وعي المواطنين في #المملكة_العربية_السعودية بالأمن السيبراني. وإذا أراد المستخدمون الازدهار في بيئة مدعومة بالذكاء الاصطناعي، فيجب عليهم البقاء يقظين ومطلعين واستباقيين في تعاملهم مع هذا المجال.

ومن خلال استكشاف إرشادات الهيئة الوطنية للأمن السيبراني (NCA)، واحتضان مبادرات الهيئة السعودية للبيانات والذكاء الاصطناعي (SDAIA) والمشاركة في برامج التدريب التي يقدمها الاتحاد السعودي للأمن السيبراني والبرمجة والدرونز (SAFCSP)، يمكن للأفراد والمؤسسات المساهمة في بناء بيئة رقمية أكثر أمانًا في #المملكة_العربية_السعودية. فالأمن السيبراني ليس مجرد مطلب تقني، بل هو مسؤولية مشتركة تتطلب اليقظة والتعليم والعمل.

وعبر فهم نقاط الضعف وتبني ممارسات قوية في مجال #الأمن_السيبراني، يمكننا الاستفادة بثقة من فوائد #الذكاء_الاصطناعي مع الحرص على حماية حياتنا الرقمية والشخصية.

لمزيد من المعلومات يمكنك زيارة المواقع التالية:

- إرشادات الأمن السيبراني من الهيئة الوطنية للأمن السيبراني (NCA)

- مبادرات ومصادر الذكاء الاصطناعي من الهيئة السعودية للبيانات والذكاء الاصطناعي (SDAIA)

- برامج التوعية بالأمن السيبراني من الاتحاد السعودي للأمن السيبراني والبرمجة والدرونز (SAFCSP)

- سياسة الخصوصية من OpenAI

- مركز الثقة لـ GitHub Copilot

ما هو شعورك؟

احببته

0

احزنني

0

اسعدني

0

اغضبني

0

لتعلق يجب أن تسجل الدخول أولاً

تسجيل دخول